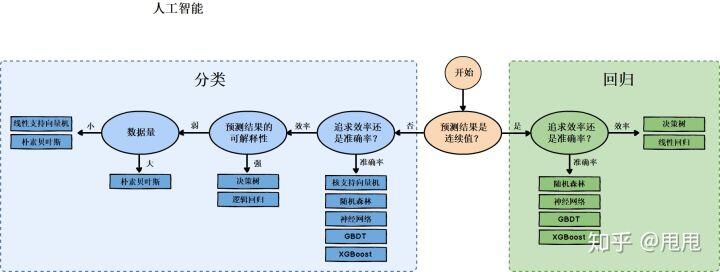

监督学习

从给定的训练数据集中学习出一个函数(模型参数),当新的数据到来时,可以根据这个函数预测结果。监督学习的训练集要求包括输入输出,也可以说是特征和目标。训练集中的目标是由人标注的。监督学习就是最常见的分类(注意和聚类区分)问题,通过已有的训练样本(即已知数据及其对应的输出)去训练得到一个最优模型(这个模型属于某个函数的集合,最优表示某个评价准则下是最佳的),再利用这个模型将所有的输入映射为相应的输出,对输出进行简单的判断从而实现分类的目的。也就具有了对未知数据分类的能力。监督学习的目标往往是让计算机去学习我们已经创建好的分类系统(模型)。

监督学习是训练神经网络和决策树的常见技术。这两种技术高度依赖事先确定的分类系统给出的信息,对于神经网络,分类系统利用信息判断网络的错误,然后不断调整网络参数。对于决策树,分类系统用它来判断哪些属性提供了最多的信息。

贝叶斯

朴素贝叶斯

高斯贝叶斯

多项朴素贝叶斯

伯努利贝叶斯

平均-依赖性评估

贝叶斯信念网络

贝叶斯网络

决策树

分类和回归树(CART)

迭代Dichotomiser3(ID3)

C4.5算法

C5.0算法

卡方自动交互检测(CHAID)

决策残端

随机森林

SLIQ

线性分类

Fisher线性判别

线性回归

线性回归模型:

代价函数:

我们的目的是将梯度下降算法应用到线性回归中,最小化。

关键在于确定

推导

当j=0时

当j=1时

现在梯度下降算法就可以表示为

重复直到收敛

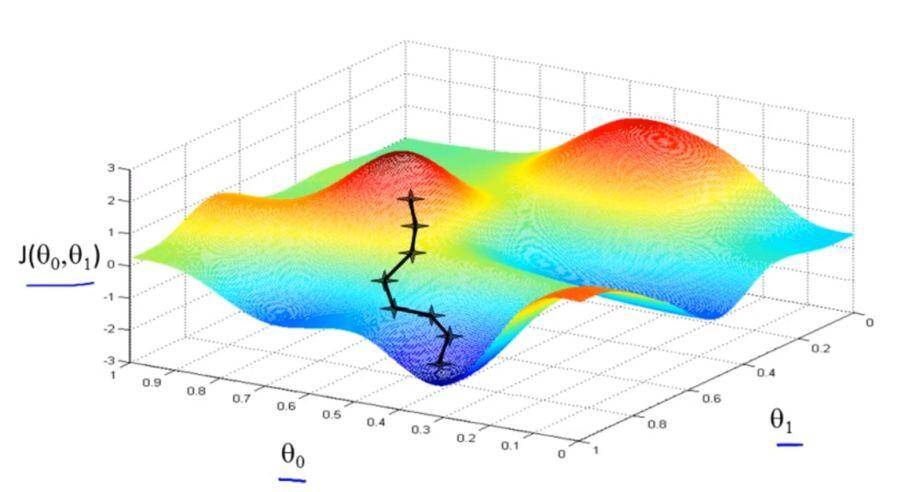

下面时梯度下降的示意图

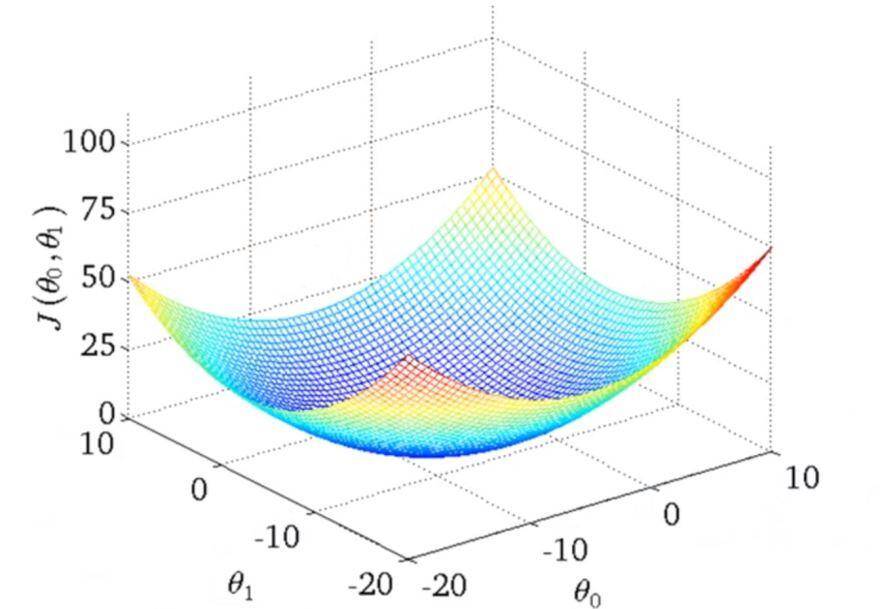

梯度下降算法会根据不同初始点的选取陷入不同的局部最小。但是就线性回归问题而言,它的代价函数的图形总是凸面函数。

算法

下面这种算法是错误的,这样在计算时已经更新,不能实现同步更新。